- Autore Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:49.

- Ultima modifica 2025-01-22 17:28.

Il generale albero di regressione costruzione metodologia consente alle variabili di input di essere una combinazione di variabili continue e categoriali. UN Albero di regressione può essere considerata una variante della decisione alberi , progettato per approssimare funzioni a valori reali, invece di essere utilizzato per la classificazione metodi.

Tenendo questo in considerazione, come funziona un albero di regressione?

Albero decisionale - Regressione . Albero decisionale costruisce regressione o modelli di classificazione sotto forma di a albero struttura. Scompone un set di dati in sottoinsiemi sempre più piccoli e allo stesso tempo un associato albero decisionale è sviluppato in modo incrementale. Il risultato finale è un albero insieme a decisione nodi e nodi foglia.

Inoltre, quali sono i diversi tipi di alberi decisionali? I tipi di alberi decisionali includono:

- ID3 (Dicotomizzatore Iterativo 3)

- C4. 5 (successore di ID3)

- CART (albero di classificazione e regressione)

- CHAID (rivelatore automatico di interazione CHi-squared).

- MARS: estende gli alberi decisionali per gestire meglio i dati numerici.

- Alberi di inferenza condizionale.

Di conseguenza, qual è la differenza tra albero di classificazione e albero di regressione?

Il primario differenza tra classificazione e alberi decisionali di regressione è quello, il alberi decisionali di classificazione sono costruiti con valori non ordinati con variabili dipendenti. Il alberi decisionali di regressione prendere valori ordinati con valori continui.

A cosa servono gli alberi di regressione?

Decisione alberi dove la variabile target può assumere valori continui (tipicamente numeri reali) sono chiamati alberi di regressione . Nell'analisi delle decisioni, una decisione albero può essere abituato a rappresentare visivamente ed esplicitamente le decisioni e il processo decisionale.

Consigliato:

Che cos'è un test dell'albero delle chiamate?

Un albero delle chiamate è un metodo di comunicazione affidabile tra i membri di un gruppo, come i dipendenti di un'azienda, i volontari di un'organizzazione o i membri di un comitato scolastico. Il test dell'albero delle chiamate dovrebbe essere eseguito ogni sei mesi per garantire un flusso regolare in tempi di crisi

Che cos'è la regressione ML?

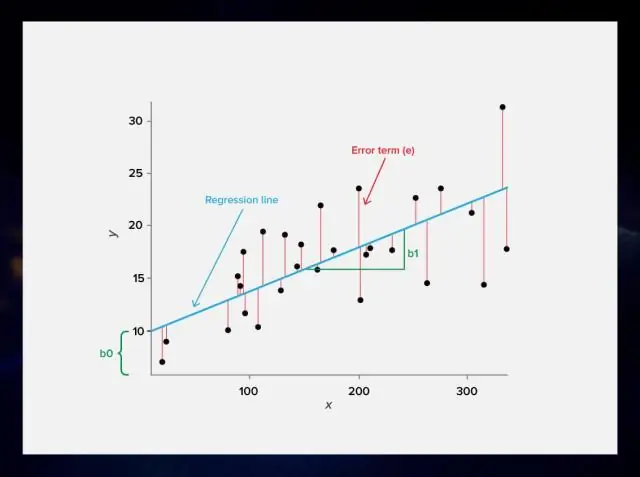

La regressione è un algoritmo ML che può essere addestrato per prevedere output numerati reali; come temperatura, prezzo delle azioni, ecc. La regressione si basa su un'ipotesi che può essere lineare, quadratica, polinomiale, non lineare, ecc. L'ipotesi è una funzione che si basa su alcuni parametri nascosti e sui valori di input

Che cos'è l'analisi dell'albero di regressione?

L'analisi dell'albero di regressione è quando il risultato previsto può essere considerato un numero reale (ad esempio il prezzo di una casa o la durata della degenza di un paziente in ospedale)

L'albero decisionale è una regressione?

Albero decisionale - Regressione. L'albero decisionale costruisce modelli di regressione o classificazione sotto forma di struttura ad albero. Il nodo decisionale più in alto in un albero che corrisponde al miglior predittore chiamato nodo radice. Gli alberi decisionali possono gestire sia dati categorici che numerici

Che cos'è la struttura dati dell'albero B?

Un B-tree è una struttura dati ad albero che mantiene i dati ordinati e consente ricerche, inserimenti e cancellazioni in tempo ammortizzato logaritmico. A differenza degli alberi di ricerca binaria autobilanciati, è ottimizzato per i sistemi che leggono e scrivono grandi blocchi di dati. È più comunemente usato nei database e nei file system. Le regole del B-Tree